gpt

Como os Transformers prestam atenção?

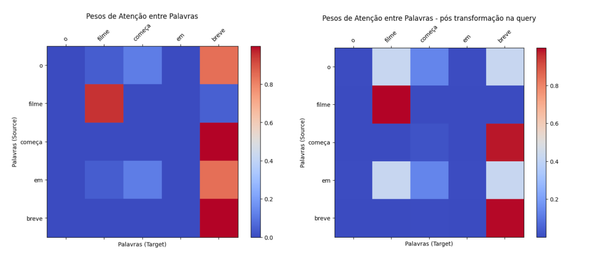

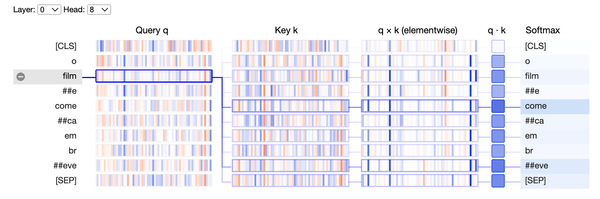

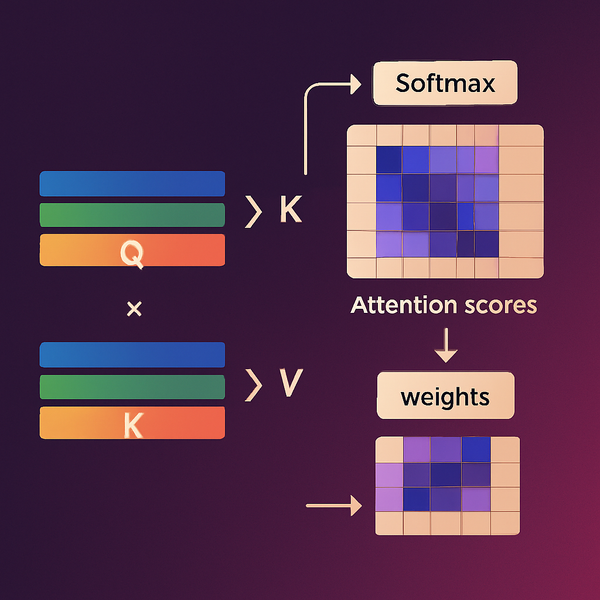

Neste artigo, você vai entender o que é atenção escalada — o mecanismo central dos Transformers. Da álgebra ao código, explico como modelos modernos aprendem a focar nas palavras certas e gerar linguagem com contexto.